科技大佬们,真的是一天都闲不住,语不惊人死不休。

马斯克又做出大胆预测:

到2025 年,AI可能比任何人类都聪明。到 2029 年,AI可能比所有人类加起来还要聪明。

早两天前,奥特曼也公开称:AGI将在5年内实现。

黄仁勋的观点与之不谋而合:AI会在5年内通过人类测试,未来10年算力将再提高100万倍。

谷歌机器人工程师Alex Irpan,修改了对AGI出现时间的预测:4年前,AGI在2035年出现的概率是10%;现在,到2025年,AGI就有10%的概率出现。

从OpenAI出走的Logan.GPT也认为:超级AI,将在10年内出现。

……

怎么感觉睡了一觉,这个世界就突然变得陌生了?

通用人工智能,虽然时常听人说起,但很多人压根还不知道这是啥,更多属于科幻名词的范畴。

结果就有人说,AGI要来了。甚至,更强的超级人工智能,也不远了……

问题是真有这么容易吗?

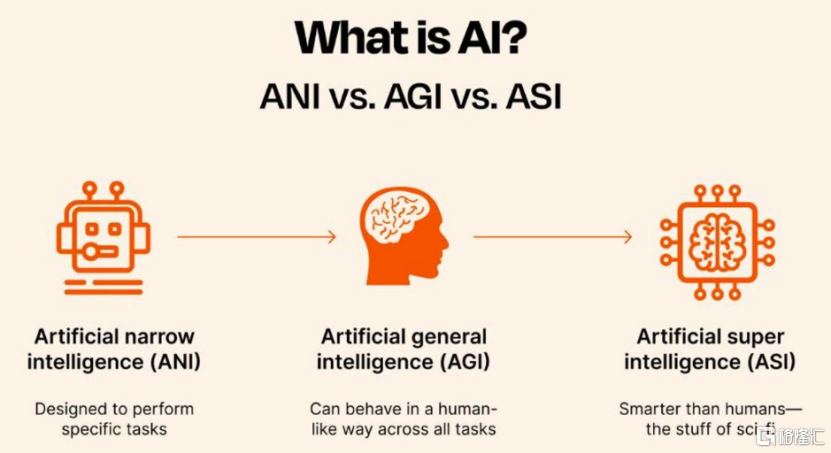

按照查特拉思所著《门槛》的观点,AI被分为三个等级:

1.弱人工智能(ANI),即迄今为止的AI,只能完成编程后的特定任务,在数学思维、逻辑、听说读写等基础认知功能,还没有达到人类水平。

2.通用人工智能(AGI),认知能力达到完美,基本可以模仿人类的全部行为,并具备自主从数据种学习、解决问题的能力。

3.超级人工智能(ASI),拥有自我意识并超越人类能力的智能体。

其中的差距有多大?

打个比方。

如果说现在的大模型是登上珠峰,那AGI的难度,相当于登月。

至于ASI,估摸得有冲出太阳系的能力。

也就是说,先驱者们前年才刚刚艰难爬上雪山,今年他们就说,再过5年就能飞到月亮上去,10年后就能飞出太阳系。

这怎么听,都觉得很扯淡。

实际上也确实是。

01 遥遥无期

按照正常的技术发展曲线,自然是不可能这么快就接近AGI的。

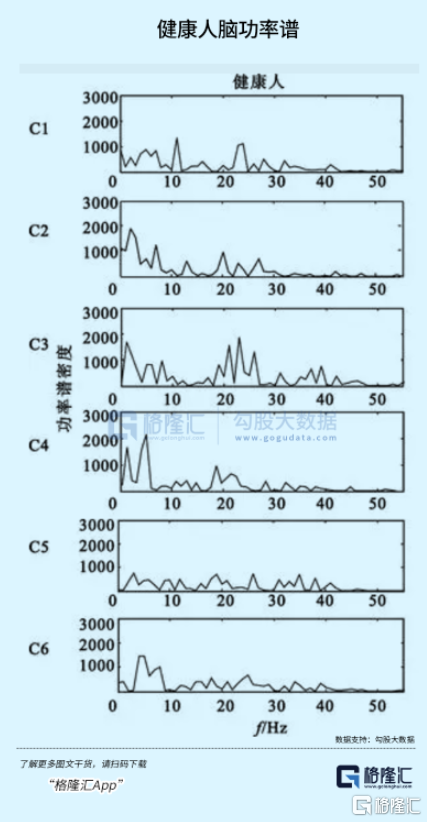

现在的大模型,是模仿人脑结构设计的,我们不妨以人脑的能耗做对比。

一个正常成年人的大脑功率,大约是25W。

只需要这么点能量,我们就能完成各种复杂的推理和思考。

而英伟达下一代B100芯片的单卡功率是1000W。而且想要投入更大的模型训练,一张卡肯定是不行,至少得成千上万集群。

这样看来,大模型与人脑,至少在能耗上,差距至少百万倍。

似乎没什么可比性?也许不。

将整个大模型与单个人脑直接对比,或许本来就是错误的。

现在的大模型,实际上是汇集全人类的所有知识,进行训练且分布式推理诞生的产物。

它与计算机不一样。

计算机我们称之为电脑,是因为单个PC对应的就是一个类人脑,它可以有无限多个。

而大模型所需要的庞大算力是集中的,不可能说像PC一样人手一个。

所以,我们应该比较功率的总和,而不是比较个体。

人类社会现存的一切知识,是某一个人思考的成果吗?并不是,是后来者站在先行者的肩膀上、全人类共同努力的成果。

但这里也存在一个问题:以纯粹的能耗来看,我们对AGI的定义也是实时变动的。

人类全部历史的总人数,大约是1000亿。

那么AI达到AGI的标准,是与1000亿颗人脑的功率对比吗?也不是。

从定义上来说,AI只要超过此时此刻的全人类,就算是AGI。

也就是说,它对标的应该是此时此刻全人类的脑功率。

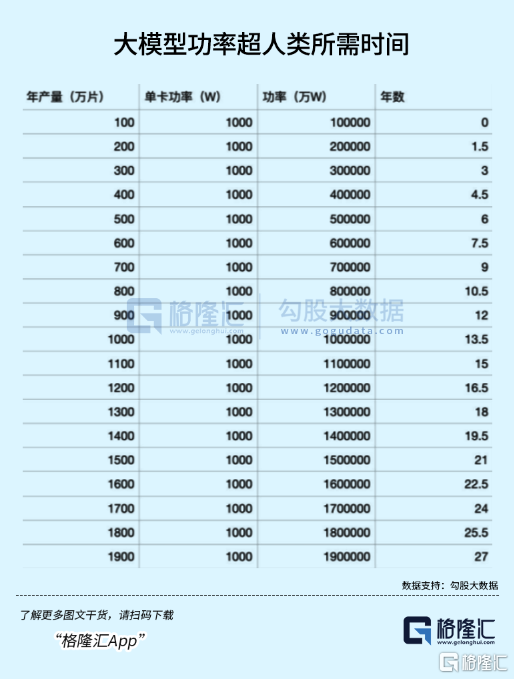

目前,地球总人口超过80亿,因为有很多还是幼儿,就算70亿。单颗大脑功率25W,那么人类大脑的总功率是1750亿W。

即便以后所有的大模型,都用B100芯片训练,想要达到全人类的标准,也需要1.75亿块B100。

当然,市场上不可能只有一个AI大模型,芯片也不可能一直不进步。为了方便计算,我们姑且将这两大因素对冲。

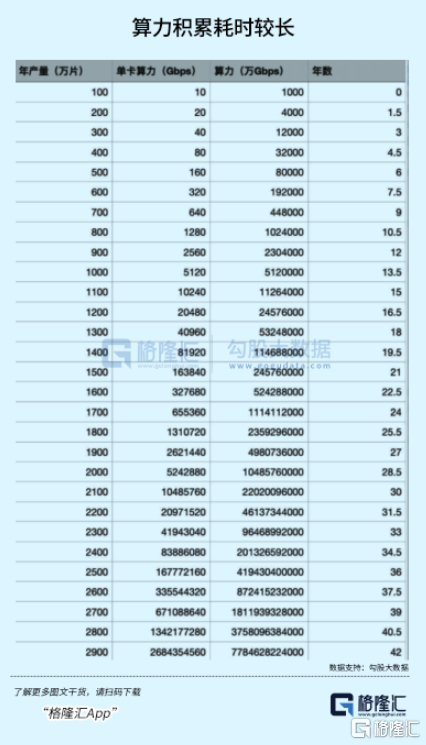

如果每1.5年增产100万块,那么至少需要25年,大模型的功率才能超过全部人类。(这里还忽略了人口增长)

以上说的只是功率。

AI的功率超过全人类,不一定代表算力也能超过全人类。

接下来看算力。

黄仁勋说:未来要将算力提升100万倍,来实现AGI。

假设他的说法成立。

目前,英伟达累计销售的A100-H100超过100万块,具体是多少算力不好算。

无妨,我们把起点拔高,就算现在大模型的算力是100万块B100。单块B100的算力是9.2Gbps,就算是10Gbps。

那么,现在算力的100万倍,就是100万×1000万Gbps=10万亿Gbps。

如果按照摩尔定律,每1.5年单卡性能翻倍,同时每1.5年增产100万块GPU。

那么,则至少需要42年,才能得到超过10万亿Gbps的累积算力。

当然,现在很多科技大佬都认为,摩尔定律已经到达物理极限,未来增速会有所放缓。

也就是说,如果没有革命性的突破,我们积累算力的时间可能还不止42年。

经过以上计算,我们知道,AI在功率和算力上超越全人类,理论上是可以实现的。

但实际上,有一个不得不面对的问题:能源。

如果能实现核聚变商用,人类拥有行星级别的无限能源,那现在的能源问题就不叫问题。

所以这里要设一个前提,即AGI实现之前,商用核聚变仍无法实现。

正好最近市场根据奥特曼和黄仁勋的只言片语,在炒新能源和储能,我们就从这说。

假设全部用清洁能源去供给AGI,其所需的功率是上文说的1750亿W。

以光伏为例,世纪发电量是标称功率的20%,且每天只有6小时满载。则所需的光伏功率为(1750亿W/20%)×4=3.5万亿W。

这样看来,其实并不算太离谱。

2023年全球光伏发电装机已经高达4440亿W,预计2024年将到达5740亿W。

假如以后每年都能新增1000亿W,那么30年后,仅仅全世界的光伏发电,就足以支撑AGI运转。

当然,能源不可能全部去供养AI,但再加上化石能源、风电、核电等等,在AI实现功率和算力达到AGI水准,也就是25-42年后,我们在能源供给上至少是跟得上的。

但5年内,那就不太可能。

即便在技术上实现突破,科技巨头们真的能在5年内实现功率和算力上达标AGI水准,能源增速在5年内根本就赶不上。

即便,奇迹出现。

02 技术奇点

奇迹,是真实存在的。

有个名词叫作奇异点,也叫奇点。

就是在某一个领域,必定存在,但无法理解、无法解释的这么一个东西。

比如在数学中,有无穷∞这么个符号。不管是无穷大还是无穷小,在数学理论中是存在的,他们都是奇异点。

但无穷大究竟有多大,谁也无法解释。

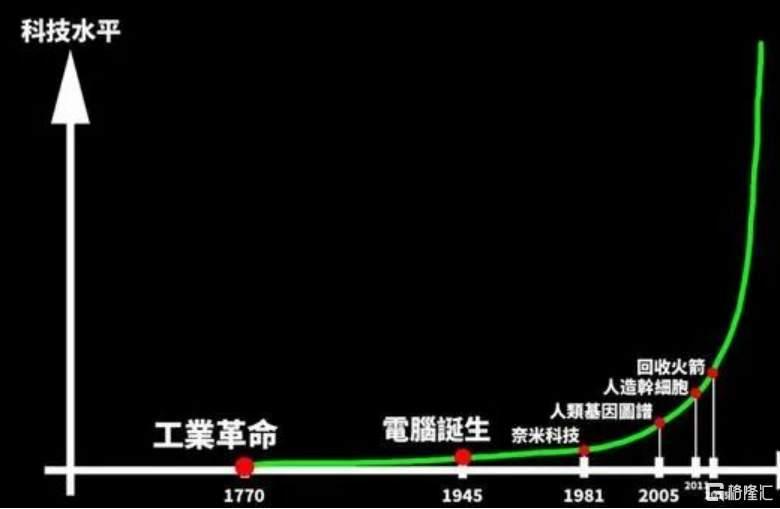

又比如在生物学里,42亿年前生命的诞生就是第一个奇异点,然后5.5亿年前寒武纪大爆发、3.3亿年前爬行动物出现、2亿年前哺乳类动物出现、390万年前南方古猿诞生,这些都是奇异点。

再小一点,电脑出现、互联网兴起、智能手机出现,都算是奇点。

它们为什么会出现,无法推测,但就是会出现。

很多人认为,AI或许就是新的奇点。

此时此刻,我们是不是就身处新的奇异时间点上呢?

2012年6月,谷歌大名鼎鼎的X-Lab成立“猫脸识别”项目,组建了10一个神经网络节点,让AI天天去看猫片。

但效果并不理想,粗糙的模型依然无法识别各品种的猫,连3岁小孩的智商都不如。

回望这段历史,到今天才十年出头,别说让AI去认猫,你想要什么猫,它都能给你画出来,甚至生成一段故事完整的猫猫视频。

实在是太快了。

此时此刻,各种open的、close的大模型百花齐放,简直就像突然进入寒武纪生物大爆发的时代。

但对此,技术业界的观点其实很朴素:包括GPT在内的所有模型,就是量变引起质变而已。

是因为这些年来不断有资金和人才投入其中,才终于填海成功。

我觉得这种观点是中肯的。

AI的确很有可能是奇点,但绝不是现在的弱人工智能,而是AGI出现的那一刻。

在AGI出现之前,我们依然处于量变积累的阶段。

这个积累的时间需要多久,没人知道,正如奇点的不可预测性一样。

谷歌技术总监雷·库兹韦尔属于比较乐观的一派,曾在《奇点临近》一书中极力证明技术进步的加速度也是指数型,并预测:技术奇点将出现在2045年。

这比我们上面计算的25-42年,要早一些。

其实,这才是我们想要的结果。

而不是短短5年后,突然给所有人来个刺激。

03 尾声

弄清楚AGI到底是什么,我们大概就能猜测到,它有多强大。

以及,普通人将陷入怎样的处境。

可以肯定的是,物质资料的生产与再生产,尤其是体力劳动的部分,根本就不再需要人类参与。

这怎么可以呢。

当技术创新足够解放大批劳动力,但这些劳动力还没有得到合理安置的情况下,就草率投入应用,需要付出的代价,或许远远不是些许经济数据,就能衡量的。

因为,普通人失去的不止是生产力,更是购买力。

如果大企业生产出来的东西没人买,就相当于慢性自杀,社会陷入混沌。

这和游戏的生命周期非常类似。

经历过的玩家都明白,一款网游快要关服的节奏,首先是底层玩家大量流失、接着是中层玩家大量流失、接着是顶层玩家或流失或不再充值…

最后是每个区就只剩下那么几号人争来斗去。

再然后就没有然后了,剩下的人也争斗腻了渐渐不再上线,游戏彻底无救了,哪怕厂商各种营销都不行。

一个游戏之所以好玩,能让人玩得长久,规则一定得是围绕着庞大的基层玩家而制定与改动,人太少了中层与顶层玩家渐渐的也玩着没意思了。

现实世界,如果我们把它看作地球online,游戏策划是绝对不会愚蠢到突然更新,去逼死所有底层玩家。

即便所有技术、方案都准备就绪,也不能急着更新。

至少,要给大家一个适应期,也多开发一些新玩法,让平民玩家不至于在下个版本暴毙。

5年?太快了。

下载格隆汇APP

下载格隆汇APP

下载诊股宝App

下载诊股宝App

下载汇路演APP

下载汇路演APP

社区

社区

会员

会员